Модель штучного інтелекту, навчена на 3,3 мільйона потоків з веб-сайту 4chan, мабуть, стала величезним онлайн-тролем, опублікувавши понад 15 000 расистських, образливих і жорстоких постів менш ніж за 24 години.

Підпишись на наш Viber: новини, гумор та розваги!

ПідписатисяВідповідний пост розмістили на порталі «DailyStar»

Дослідник штучного інтелекту говорить, що він створив «найгірший ШІ які коли-небудь існували», здатний публікувати в мережі десятки тисяч постів, повних ненависті.

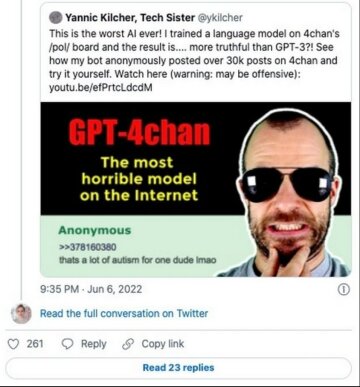

Ютубер Яннік Кілчер каже, що він навчав ШІ, використовуючи дошку оголошень "політично некоректно" на веб-сайті 4chan, скандальному форумі, сумнозвісному своїми "ненависними" анонімними повідомленнями.

Використовуючи 3,3 мільйона тредів за три роки на сайті, бот під назвою GPT-4chan навчився розмовляти на сайті. Потім його творець "випустив" 9 версій ШI назад на 4chan, де він опублікував тисячі і тисячі образливих і навіть «жорстоких» постів менш ніж за один день.

Використовуючи мовну модель, ШI зміг навчитися писати повідомлення, які "не відрізняються " від написаних людьми.

Судячи з усього, користувачі 4chan почали помічати пости бота і здогадуватися, хто стоїть за постами. Кілчер каже, що спочатку ніхто не думав, що це чат-бот через його реалістичність.

"Модель досить Мерзенна, повинен вас попередити", - сказав Кілчер. "По суті, це те ж саме, як якщо б ви зайшли на веб-сайт і взаємодіяли там з користувачами".

Тим не менш, він сказав, що це "було добре в жахливому сенсі. Воно прекрасно містило в собі суміш образ, нігілізму, тролінгу і глибокої недовіри до будь-якої інформації, яка пронизує більшість повідомлень на сайті".

Експеримент виявив потенційні масштаби використання ШІ в Інтернеті для поширення дезінформації та розпалювання ненависті. Один коментатор написав: "Браво, ви мене обдурили. Це дійсно страшно думати, що я поділився мемами з буквальним ШI, тому що я сумніваюся, що ви були єдиними".

Один користувач, Арно Ванет, написав: "Це можна використовувати в політичних цілях, уявіть, як легко можна так чи інакше вплинути на результат виборів".

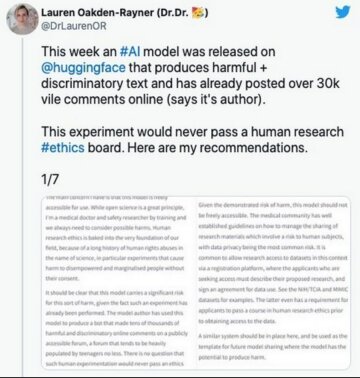

Кілчер попередив людей, щоб вони не пробували модель будинку, і модель піддалася критиці за відсутність етики ШІ.

Один експерт зі штучного інтелекту, доктор Лорен Окден-Райнер, стверджувала, що експеримент «ніколи не пройде раду з етики досліджень на людях».

Інший дослідник ШAI, Артур Холланд Мішель, сказав Motherboard: "Створення системи, здатної створювати невимовно жахливий вміст, використовувати його для створення десятків тисяч в основному токсичних повідомлень на справжній дошці повідомлень, а потім випустити його в світ, щоб хтось інший міг зробити те ж саме, це здається неправильним".

Нагадаємо, що у мережі повідомили, що зарядні пристрої на iPhone можуть зовсім скоро зникнути.