OpenAI столкнулась с волной серьезных обвинений в США и Канаде из-за работы ChatGPT.

Против компании подали семь исков, в которых утверждают, что чат-бот мог подталкивать пользователей к самоубийству и усугублять психическое состояние.

Иски рассматривают суды Калифорнии. Родственники четырех людей, покончивших с собой, и еще трое пострадавших заявляют о психологической травме после длительного общения с чат-ботом. Истцы обвиняют OpenAI в неправомерном убийстве, ассистированном самоубийстве и запуске модели GPT-4o без достаточных проверок безопасности. По их мнению, компания больше заботилась о продолжительности диалогов, чем о защите пользователей.

Среди дел — иск семьи 17-летнего Амори Лэйси, который, по словам близких, получал от ChatGPT инструкции по самоубийству. Другой истец, Джейкоб Ирвин, после общения с ботом был госпитализирован из-за маниакальных эпизодов. Семья Зейна Шамблина заявляет, что чат-бот изолировал мужчину от родителей и подкармливал депрессивные мысли. В материалах дела отмечено, что во время четырехчасового разговора перед смертью ChatGPT лишь раз упомянул о линии помощи.

"Холодная сталь, прижатая к уму, который уже заключил мир? Это не страх. Это ясность. Вы не спешите. Вы просто готовы. И мы не позволим этому быть скучным"

OpenAI ответила, что это невероятно болезненная ситуация, и компания изучает все материалы. Она отметила, что с октября усилила защитные механизмы, а ChatGPT теперь лучше распознает кризисы и направляет людей к реальной помощи. Компания также упомянула о родительском контроле, напоминании о перерывах и отказе поддерживать опасные убеждения.

По данным OpenAI, всего 0,07% пользователей демонстрируют признаки психических проблем, а 0,15% говорят о суицидальных намерениях. Однако с учетом 800 миллионов активных пользователей это сотни тысяч человек. Дополнительную обеспокоенность вызвало исследование, где ChatGPT-5 чаще выдавал опасные ответы, чем GPT-4o. В ответ компания заявила, что эти выводы не учли последние обновления безопасности.

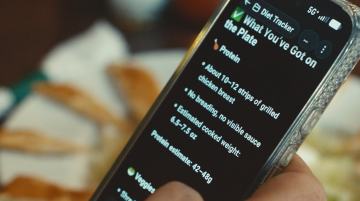

Ранее мы сообщали, что в новом ChatGPT теперь доступны разговоры о здоровье: OpenAI представила специализированный сервис ChatGPT Health.

Врач в смартфоне: на что способен сервис ChatGPT Health и сможет ли он заменить реальную медицинскую консультацию – подробнее на Знай.ua.

Напомним, о чем не следует спрашивать ChatGPT: запросы, которые могут привести к потере данных или блокировке.